MIT(マサチューセッツ工科大学)の研究者は、内部的に発した言葉(実際には声を出していない言葉)を読み取るサイレント音声認識技術「AlterEgo」を発表しました。

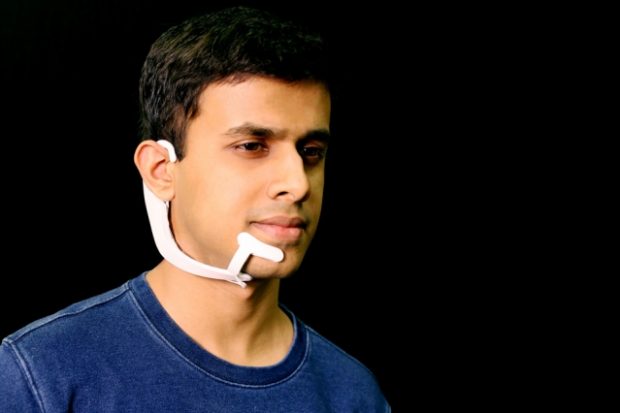

本技術は、実際に声を出していない言葉を読み取る内部音声認識デバイスを提案します。口元に密着するウェアラブル装置を使用し、装置に整備された4つの電極からユーザの顎や顔の神経筋信号を読み取ることで言葉を予想します。人には検出できない内部の微妙な動きを検出します。

単語と結びつける推定には、訓練された機械学習システムを用いており、ニューラルネットワークを使用して、特定の神経筋信号と特定の単語との相関関係を見出します。実験では、約92%の精度で正しく認識することができたと報告します。

また、骨伝導ヘッドフォンと一体になっており、出力と入力を同時に静かな中で行うことも可能にします。

これら機能を利用した実験が紹介されます。それは、チェスをプレイ中に相手の動きを静かに報告し、コンピュータが推奨する回答を静かに受け取って指すというものです。静かにマシーンに伝え、マシーンが手を考えユーザに骨伝導で伝えると。

また、デモ映像では、「時間は?」→「10:43AM」と現在の時間を聞いて受け取ったり、食品売り場にて3つの商品それぞれの金額を入力していき合計金額を受け取ったりしています。

お詫びと訂正

お詫びと訂正:数時間前に投稿した以下の記事に誤りがあり訂正とお詫びを申し上げます。口パクと表記しましたが、実際には口を開いておらず内部的に発した言葉を読み取った内容でした。間違った内容を掲載しご迷惑かけたこと深くお詫び申し上げます。記事は、タイトル及び内容を訂正いたしました。 https://t.co/kk0IXL89g7

— Seamless (@shiropen2) 2018年4月5日

関連

[東京大学]口に何もない状態でもバーチャル食品の食感をシミュレート。電気的筋肉刺激を用いて硬さや弾力性を再現。グミの模倣が最も効果的 | Seamless