Googleは、TensorFlow向けとしてスマートフォンなどのモバイル端末のために設計されたコンピュータビジョン・ニューラルネットワーク・ファミリの次世代モデル「MobileNetV2」をオープンソースとして発表しました。

GitHub:models/research/slim/nets/mobilenet at master · tensorflow/models

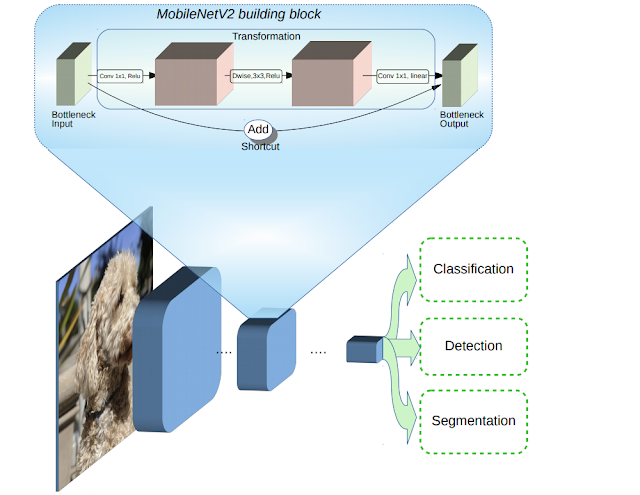

(MobileNetV2アーキテクチャ)

昨年、同社はスマートフォンに基づいた機械学習による視覚認識技術において、スマートフォンが大量の電力消費を必要とせずに画像をよりよく認識できるよう支援するTensorFlowベースのコンピュータビジョンモデル「MobileNetV1」を発表しましたが、今回はその改良版として発表されます。

従来モデルより、分類、オブジェクト検出、セマンティックセグメンテーションなどのモバイル視覚認識のための機能をさらに強化しており、Google Pixel端末では、従来モデルのMobileNetV1より30〜40%高速で、他にもすべてがより高い精度を実現しました。

![]()

(MobileNetV1とMobileNetV2の比較表。Pixel 1でTensorFlow Liteを使用)

MobileNetV2は、レイテンシ、サイズ、精度をトレードオフし、バッテリー消費を低減した低消費電力を実現しており、小規模、低遅延、低電力のモバイルファースト・コンピュータビジョンモデルとして機能させます。TensorFlow-Slim Image Classification Libraryの一部としてリリースされます。

クラウドに送るのではなく、モバイル上でニューラルネットワークを実行する利点としては、セキュリティ、プライバシ、レイテンシが緩和されること、そして、いつでもどこでもアクセスできるユーザーエクスペリエンスの向上が言えます。

関連

Google、機械学習をスマートフォンだけで処理する低遅延、低電力の画像認識技術におけるコンピュータビジョンモデル「MobileNets」をGitHubにて公開 | Seamless