マイクロソフトの研究機関「Microsoft Research」は、「Haptic Retargeting」と呼ばれるVR内の触覚フィードバックを強化するフレームワークを研究論文で公開しました。(PDF)

Haptic Retargetingとは

VR内のオブジェクトに触ったとき、その感触をリアルに感じさせる技術を触覚フィードバックと言いますが、Haptic Retargetingはそれを効率的に強化した技術になります。

感触を伝える方法としては、VR内のオブジェクトと同じものを実世界にも用意し直に触るといったものです。ここでは小さな箱が用意され、VR内の箱を掴めば、実世界の物理的な箱も掴み感じるといった具合です。

そして、今回の技術を簡単にいってしまえば、単一の物理的な箱で複数のVR内の箱を提供することができる、といった技術です。つまり、1つのリアル箱で複数のVR箱を触覚フィードバックとして表現することができるというわけです。VR内に3つ箱があったとしても、1つのリアル箱を用意するだけでよいといった具合です。

(VR内は3色の箱、実世界では1つの箱)

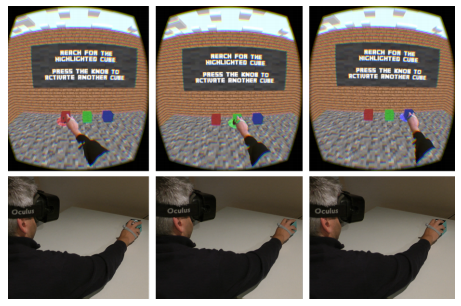

では、どうすればそんなことが出来るのか。3つのアプローチを説明します。実験内容は、上記で述べた小さい箱を使ったもので、手の位置追跡には手にマーカーを取り付け外部カメラによってトラッキングします。

3つのアプローチ

- 「Body Warping」、VR内で手の動きを変化させ錯覚させる身体操作アプローチ。

- 「Word Warping」、画面全体を変化させ錯覚させる世界操作アプローチ。

- 「Hybrid Warping」、1と2の混合。

下記のGIFは1つ目のアプローチです。

順番に青、緑、赤の箱に触れているのが分かると思いますが、一方で実際は1つの箱にしか触っていない事実が見て取れると思います。VR内の手だけは分からないよう微妙に変化させているのですね。といった感じです。他2つのアプローチテストは公開されている実験映像で確認することができます。

今回の研究の最終的な結果としては、インタラクションにおける副作用を抑えながら最高の満足度とプレゼンススコアを達成したとしています。

論文

今回のは、現地時間2016年5月7-12日に米サンノゼで開催されたACMベースHuman-Computer Interaction(HCI)のトップカンファレンス「CHI 2016」にて提出された研究論文になります。論文はこちらから読めます(PDF)。

手の追跡によるジェスチャー操作との連携

Microsoft Researchは、手の追跡によるジェスチャー操作の研究にも取り組んでいます。コンピュータビジョンベースによる手の追跡は、指の詳細な動きまで検知しVR内の手に反映させます。Microsoftとしても手のジェスチャー操作と今回のフレームワークにみる触覚フィードバックとを連携させたいと考えています。

ジェスチャー操作の詳細に関しては過去記事をご参照していただければと思います。

合わせて読みたい

また、Microsoft Researchは別の論文も提出しています。VRヘッドセットの視野を拡張する技術です。

マイクロソフトリサーチ、VR/ARヘッドセットにおける視野拡張実験を論文で発表 | Seamless