東京大学とソニーコンピュータサイエンス研究所による研究チームは、字幕付き動画を見ている視線の動きを追跡することで英語レベルを推定し、各個人の英語レベルに適した英語学習を構築できるシステム「SubMe」を発表しました。

論文:SubMe: An Interactive Subtitle System with English Skill Estimation Using Eye Tracking

著者:Katsuya Fujii and Jun Rekimoto

所属:The University of Tokyo Bunkyo-ku, Tokyo, Japan. Sony Computer Science Laboratories, Inc.

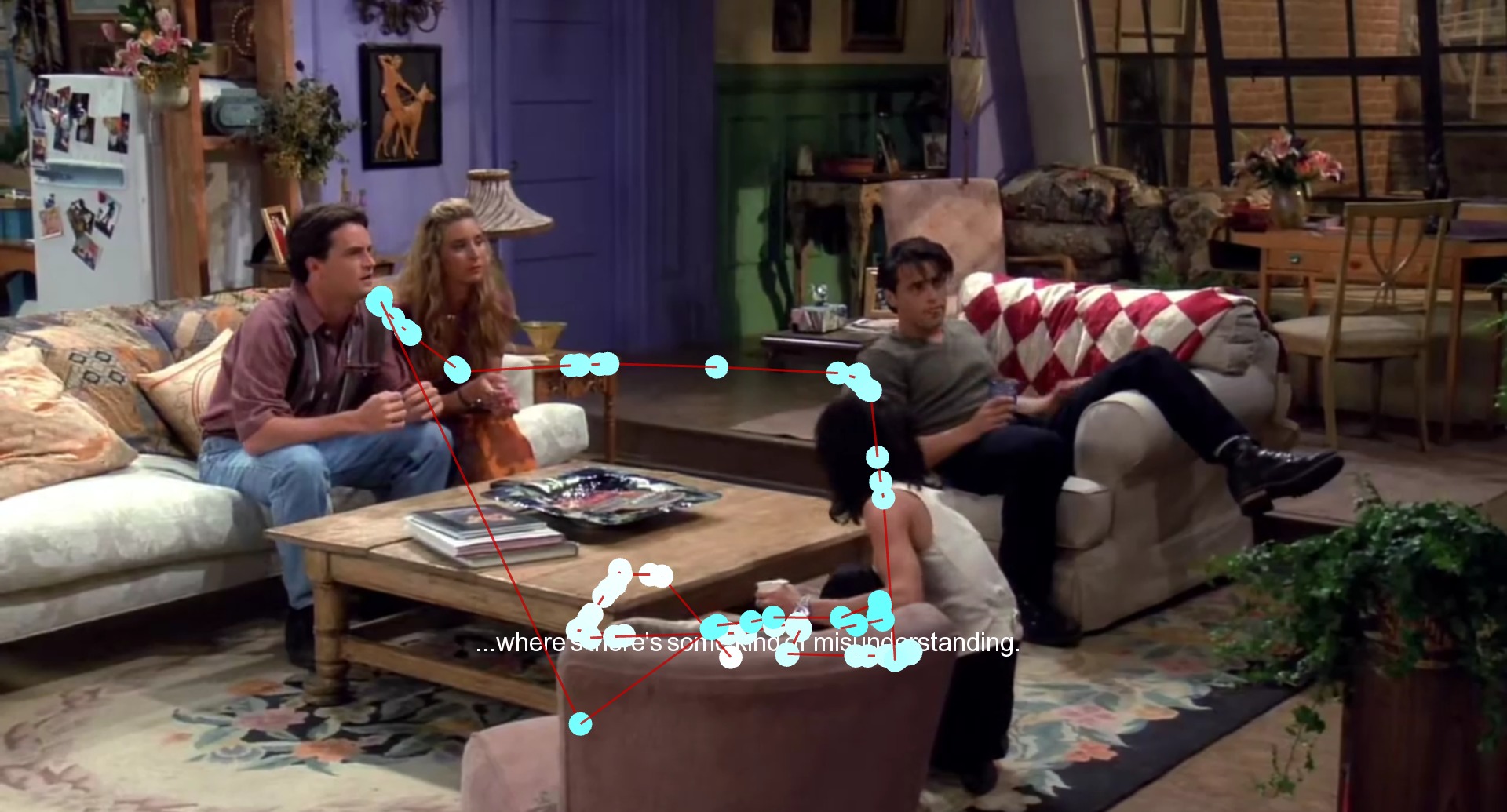

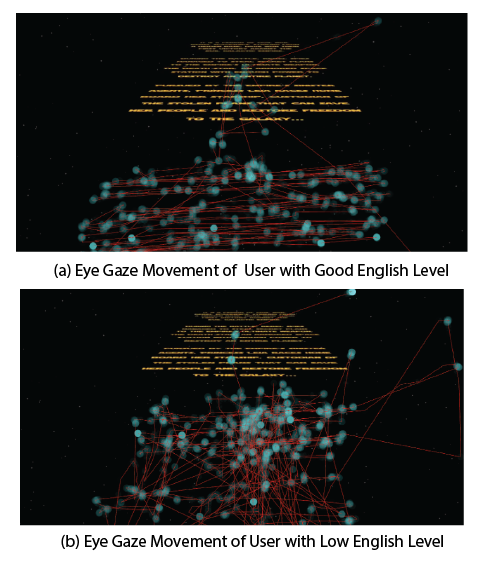

本研究は、StarWarsの下から上に流れるオープニング・クロールを読む視線を記録する課程で生まれました。英語レベルが高いユーザと、英語レベルが低いユーザにオープニング・クロールを読んでもらい視線を計測したところ、英語レベルが低いユーザの方が視線の動きが縦に多い傾向、英語レベルが高いユーザの方が下の方に注視がまとまる傾向など、視線動向を分析することによって、英語レベルを区別できることが分かり本研究を始めることになります。

(a)英語レベルが高いユーザ。(b)英語レベルの低いユーザの視線追跡を視覚化した図。

本研究では、字幕付き動画の視線動向から各ユーザの英語レベルを推定し、そのデータを用いて学習に必要であろう英単語のみを日本語翻訳として字幕と一緒に表示することで学習するシステムを提案します。

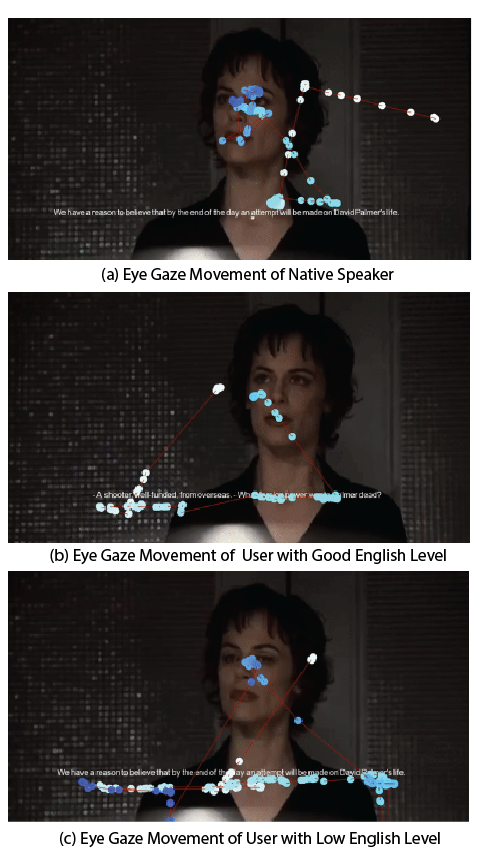

最初に、様々な英語レベルユーザの眼球運動を、PCに取り付けたTobii EyeTracker 4Cを用いて記録します。分析は単語ベースではなく、字幕1行あたりの注視数と要した時間を用います。分析結果は、英語レベルが低いユーザの方が字幕への注視数が多く、費やす時間も多い傾向が分かりました。

(A)英語ネイティブユーザ、(B)英語レベルが高いユーザ、(C)英語レベルが低いユーザの視線追跡を視覚化した図

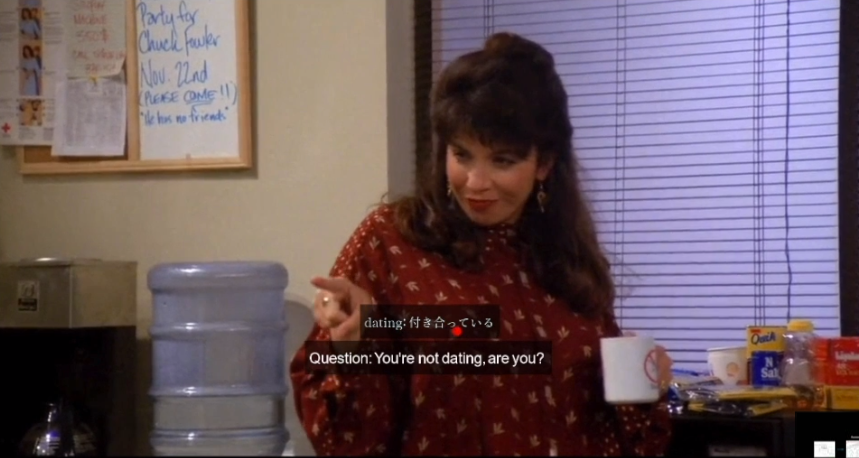

この分析結果を用いてランダムフォレストを用いた機械学習を実行します。まず、現代アメリカ英語のコーパス「COCA(Corpus of Contemporary American English)」を用いて、各単語の難易度を計算しておきます。ユーザが理解できないと思われるすべての字幕の平均スコア(この値が低いほど知らない単語が多い)を取得し、取得した値から英語レベルを推定し最適化した英語学習を提示します。提示方法の1つとして、各ユーザの英語レベルに合わせて、知らないであろう英単語のみを日本語翻訳し字幕の上に表示します。

字幕の上に、知らないであろう英単語の日本語翻訳のみを同時に表示することで学習する。

そうすることで、ユーザは知らないであろう英単語のみを日本語翻訳で確認しながら字幕を読むことができ、動画をよりよく理解できると同時に、自分の英語レベルに最適化した効率的な学習をすることが可能となります。