東北大学電気通信研究所の塩入諭教授の研究グループは、人間の視覚系が無意識に周囲環境を学習し脳内にモデルをつくることで、直接見ることができない頭の後ろの情報も処理していることを明らかにしました。

論文:Spatial representations of the viewer’s surroundings

著者:Satoshi Shioiri, Masayuki Kobayashi, Kazumichi Matsumiya, Ichiro Kuriki

本研究は、繰り返しの視覚的観察によって無意識に学習される潜在学習が、眼や頭を動かさないと見ることができない視野の外側も含めた周囲環境に対しても起こることを実験的に示しました。

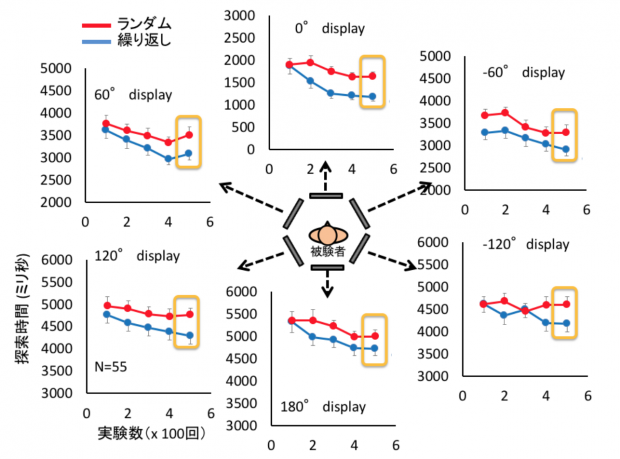

実験は、被験者の周囲を取り囲む6台のディスプレイに、文字をランダムに配置し、その中からターゲット文字を探すという課題で行われます。被験者は、頭や体を動かしながら探索を行い、その様子からターゲットを見つけるまでの時間を計測します。

文字の配置が毎回新しいものに変わる「ランダム配置」と、12の配置パターンを繰り返す「繰り返し配置」を何百回も行い比較しました。

結果、ランダム配置よりも繰り返し配置の方が、より探索時間が短いことが分かりました。この実験から、自分の周囲を取り巻く視覚刺激から文脈を学習し探すべきターゲットの位置が早くわかるようになることを示しました。

これは、正面にあるものから、背後にあるターゲット位置を推測することができる能力といえ、しかもこのことに、被験者は全く気付かないことから、潜在学習によって周囲の環境を理解しているといえます。

これらのことで、繰り返し見る環境に対しては、実際に見えている正面の情報から、自分の周囲全体を知覚することができると考えられます。

言い換えると、同時にみることができる視野内の情報だけでなく、被験者を取り巻く360°の視野にあるものの配置を覚え、脳内に周囲の環境に対するモデルとして無意識に構築しているといえます。