チューリッヒ工科大学、デルフト工科大学の研究者らは、複数の追従型ドローンを用いて、人の3D姿勢推定をリアルタイムに行うフレームワークを発表しました。

論文:Flycon:Real-time planning for automated multi-view drone cinematography

著者:T. Naegeli、S. Oberholzer、S. Pluess、J. Alonso-Mora、O. Hilliges

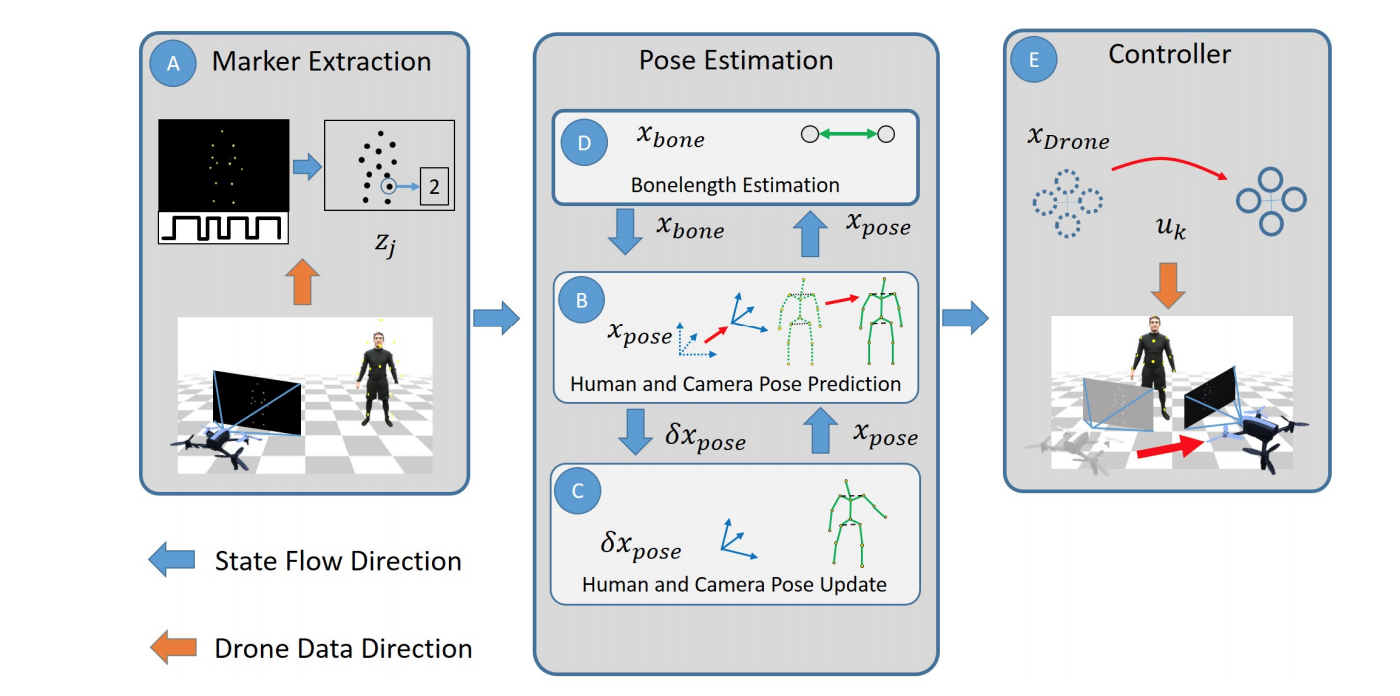

本論文は、複数のカメラ付きドローンを追従させて、人物の3D姿勢推定をリアルタイムに行う提案をします。ドローンは、13個のLEDマーカを身にまとった被写体を常にフレーム内に保つように設定しておき、追従させます。屋外であっても、GPSなどの外部信号に依存しません。

本提案手法は、各ドローンから検出した人の2D関節をラベル付けし、各ドローンの位置と向き、人間のポーズ位置(およびポーズの長さ)を推定し、ドローン群の相対位置および向きを最適化します。

最後に、被験者の動きの下でマーカを観察可能にするために、モデル予測制御(MPC)を介してドローンの制御入力を計算します。これにより、固定カメラを使用せずに、屋内外でも、大規模で長時間な移動でも、環境に依存せず人間の姿勢パラメータをオンラインで正確に推定します。