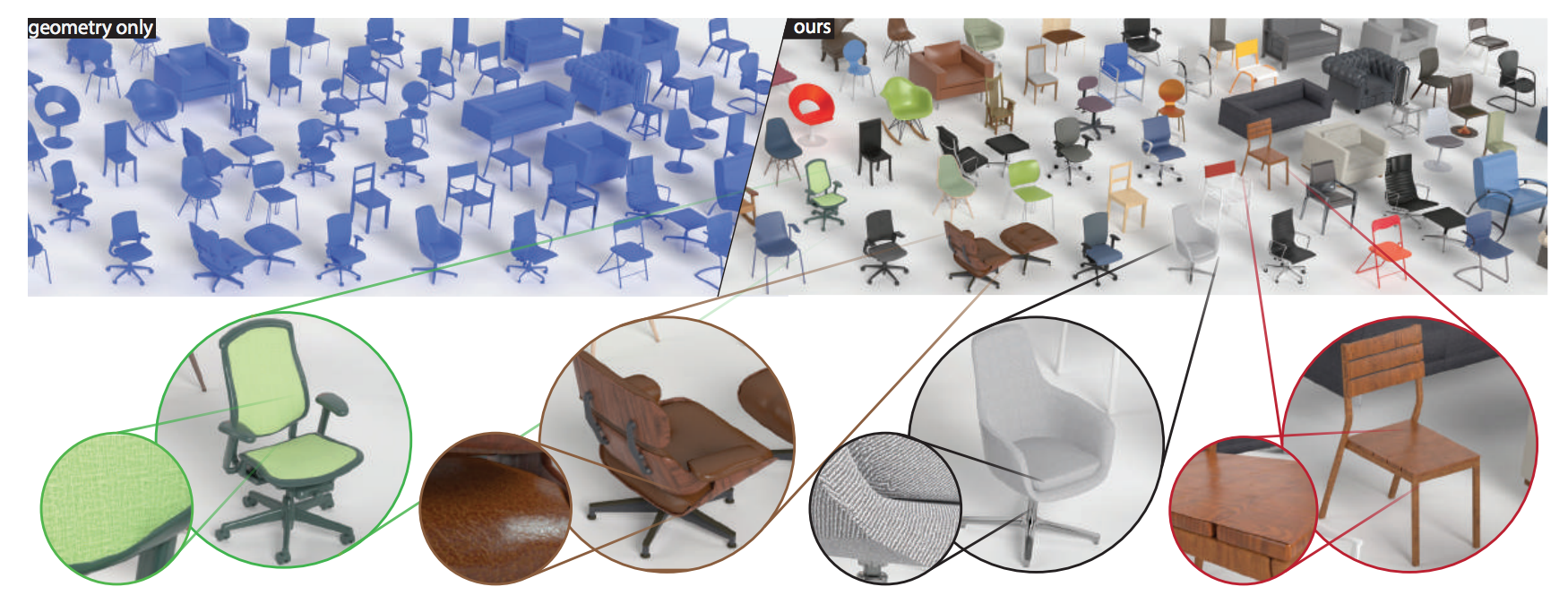

ワシントン大学とアレン人工知能研究所の研究者らは、既存の3D形状に対して、各部分にSV-BRDFによるマテリアルを自動的に割り当てるdeep learningを用いたテクスチャリング・システム「PhotoShape」を発表しました。

論文:PhotoShape: Photorealistic Materials for Large-Scale Shape Collections

著者:Keunhong Park, Konstantinos Rematas, Ali Farhadi, Steve Seitz

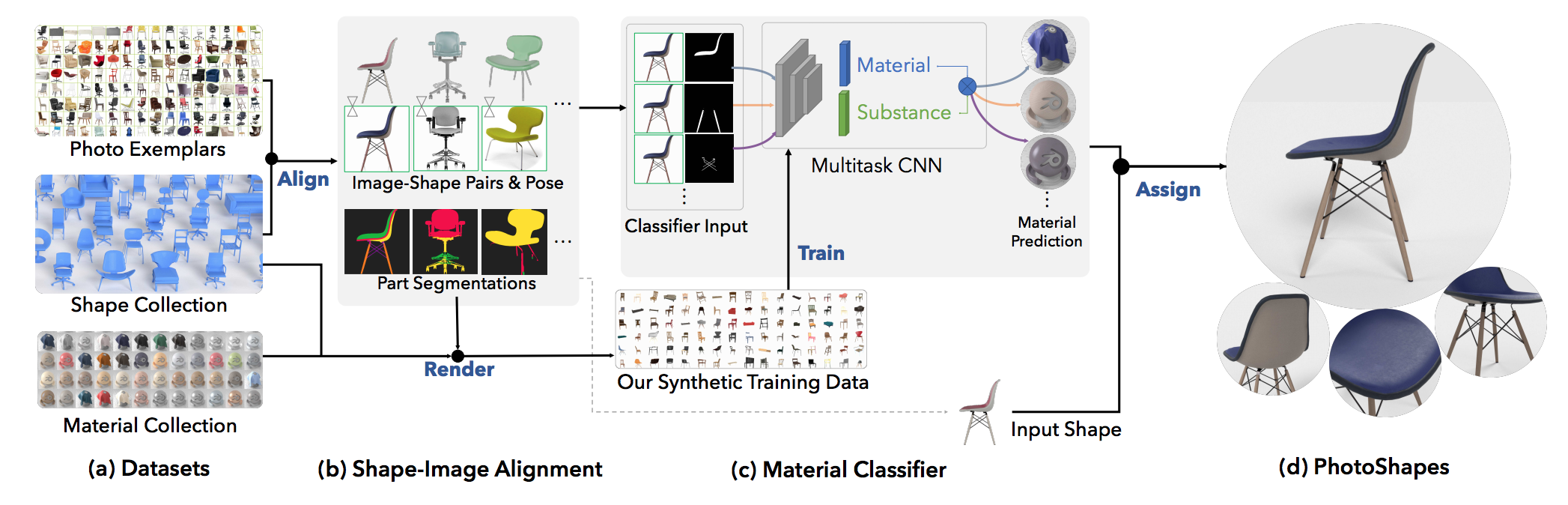

既存の3D形状リポジトリは、大量の3Dモデルが保管されていますが、写実的なモデルは少ないのが現状です。そこで、本論文は、そういった3D形状に対して、自動的にフォトリアリスティックなテクスチャを割り当てるフレームワークを提案します。これにより、写実的で再現性のある3D形状を大量に生成します。

本提案手法は、本来手動で行うどこにどんなマテリアルを適応するかといった作業を、ネット上にある写真を参照として活用することでそのプロセスを自動化します。参照に使用する写真のテクスチャを、そのまま転写するのではないことに留意です。

マテリアルを推定するために、deep learningを用いて、3D形状に適用されたBRDFの何千もの合成レンダリングを訓練し、参照写真のパッチ(対象画像を部分的に切り出したもの)をマテリアルデータベースにマッピングする分類器を作成します。そして、3D形状の各部分にもっともらしいSVBRDFを割り当てることで出力します。