UC Santa Barbaraや香港科技大学などによる研究チームは、プロのカメラマンによる空撮を模倣するように学習する自律型ドローン撮影システムを発表しました。

論文:Learning to Film from Professional Human Motion Videos

著者:Chong Huang, Chuan-En Lin, Zhenyu Yang, Yan Kong, Peng Chen, Xin Yang, Kwang-Ting Cheng

所属:University of California, Santa Barbara; Hong Kong University of Science and Technology; Zhejiang University of Technology; Huazhong University of Science and Technology

本論文は、ドローンによる空撮において、人間のモーションビデオをキャプチャするための被写体とカメラの動きを推定するフレームワークを提案します。ドローンを使って人間の動きを撮影することは非常に困難な作業です。なぜなら、次のカメラの動きを決定するために、シーン、被写体の動き、カメラの動きを総合的に考慮する必要があるからです。

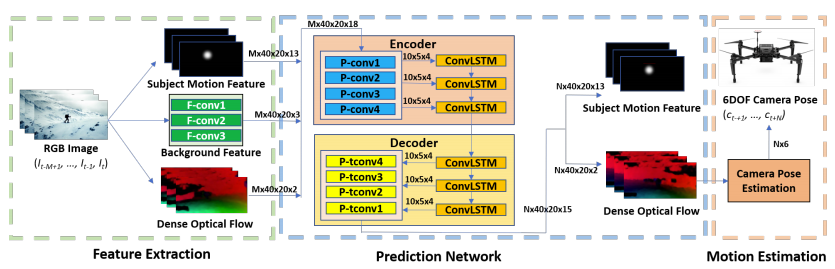

本提案手法は、これらを解決するために、前の被写体とカメラの動き、そして背景シーンを入力とし、次のシーンの被写体とカメラの動きを予測する模倣学習フレームワークを実行します。被写体の動きは、YOLOv3とOpenPoseから人のキーポイント13個を抽出し各キーポイントの動的マップを作成します。背景シーンは、3層の畳み込みエンコーダを使用して画像からCNNの特徴を抽出し、カメラの動きはオプティカルフローを使用し抽出します。

これらを入力に、エンコーダおよびデコーダを含むSeq2Seq ConvLSTMモデルに基づいたネットワークで訓練します。訓練には、プロのカメラマンが空撮した92本のビデオクリップから構成されるデータセットを使用します。

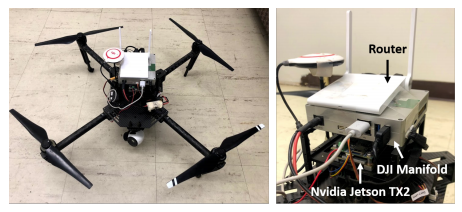

実験に使用したプロトタイプは、DJI Matrix 100をベースにしたカスタムドローンで、オンボードプロセッサモジュールにはNvidia Jetson TX2とDJIManifoldを使用します。 無線通信を可能にするために、両者ともUSB駆動のルーターを装備しています。実験結果は、DJI SparkドローンによるActive Track機能を用いた映像のように、被写体を真ん中に固定し追跡する映像ではなく、シネマティックにプロが空撮したかのような相対的な視点で映像を作成することを実証しました。