ユニヴァーシティ・カレッジ・ロンドンとAdobe Researchの研究者らは、衣服のスケッチを入力に、ドレープ(布を垂らしたときにできるひだ)付きの3D衣服を、任意の身体に合わせて設計できるフレームワークを発表しました。

論文:Learning a Shared Shape Space for Multimodal Garment Design

著者:Tuanfeng Y. Wang, Duygu Ceylan, Jovan Popovic, Niloy J. Mitra

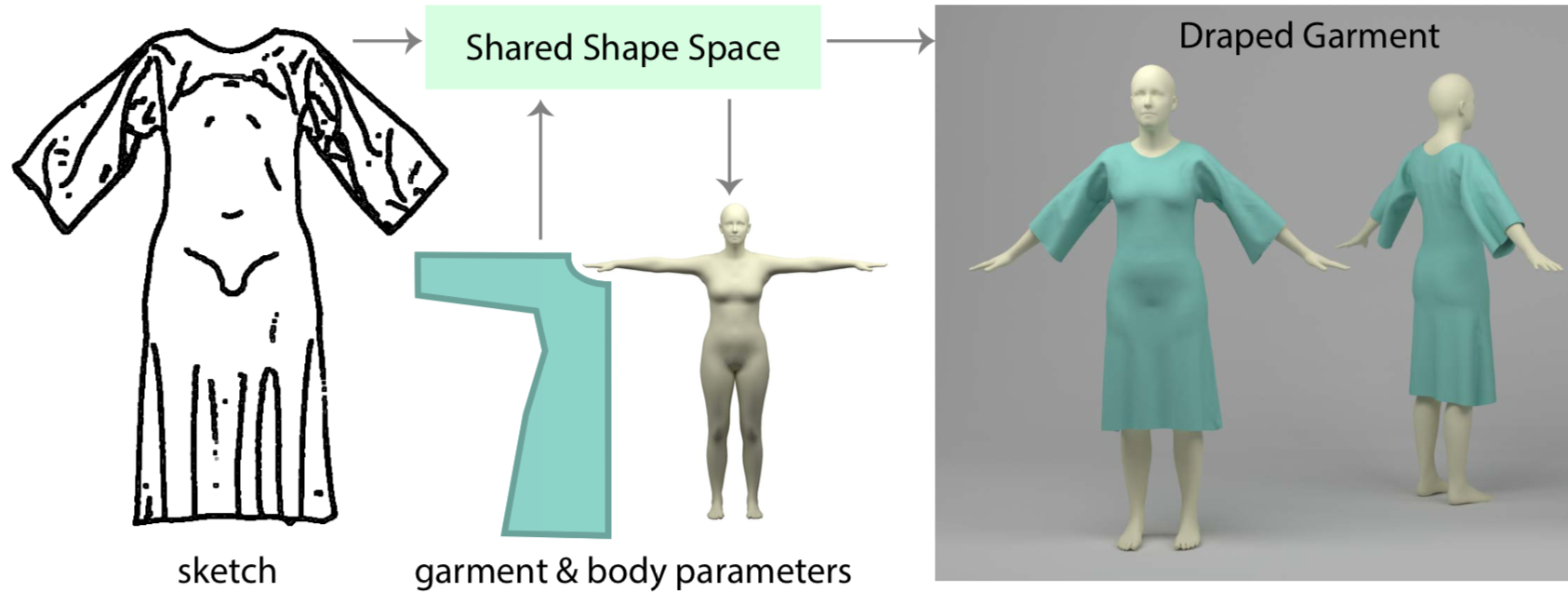

本論文は、衣服のスケッチを入力に、ドレープ含む3D衣服を設計するデータ駆動学習フレームワークを提案します。

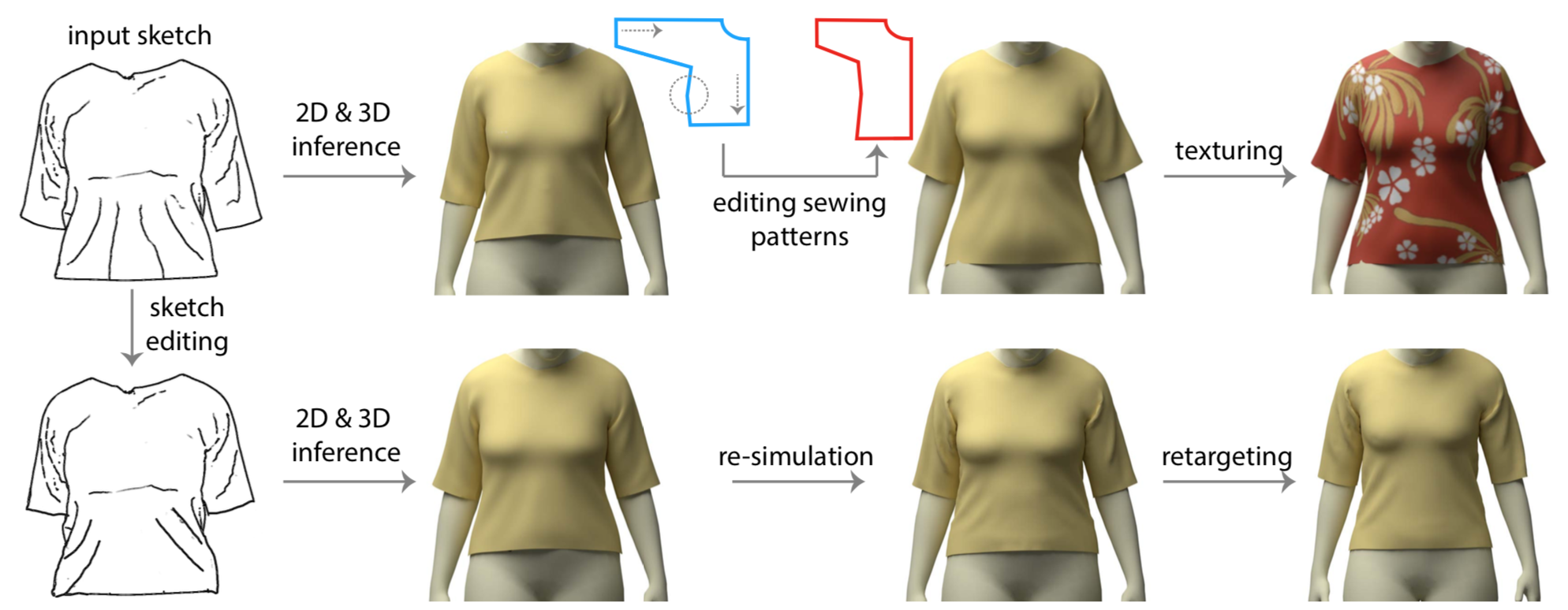

本提案手法は、折り目パターンを含む衣服スケッチから、2D衣服の縫製パターンと3Dボディ形状パラメータを自動的に推測し、取得したパラメータからドレープされた3D衣服形状を予測します。

ネットワークは、複数のエンコーダ/デコーダネットワークを訓練することによって、 2D縫製パターン、衣服および身体形状パラメータ、ドレープ衣類形状を学習します。そのための大規模な合成データセットも作成しました。

ネットワークが推測した3D衣服は、自動でuv座標が付いているため、テクスチャ加工することができます。

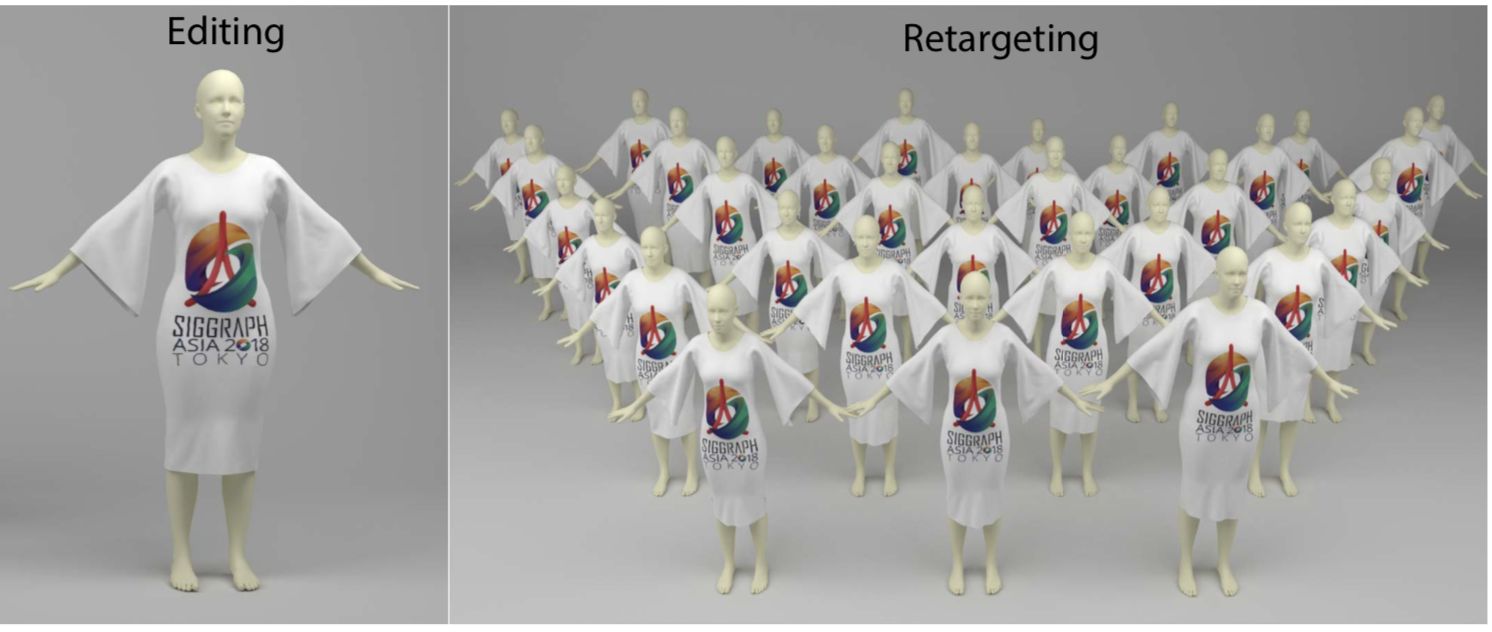

これにより、計算力が高い物理シミュレーションを必要とせずに、複雑なドレープ衣服をインタラクティブに設計および編集し、また、出来上がった衣服は、元のスタイル(折り目パターン、シルエットなど)を維持しながら、異なる身体形状にリターゲットすることが可能です。