ETH Zurichとニューヨーク大学による研究チームは、リアルタイムに手のポーズを推定するdeep learningを用いた柔らかく軽量な低コストグローブデバイスを発表しました。

論文:Interactive Hand Pose Estimation using a Stretch-Sensing Soft Glove

著者:Oliver Glauser, Shihao Wu, Daniele Panozzo, Otmar Hilliges, Olga Sorkine-Hornung

所属:ETH Zurich, New York University

本論文は、外部の光学機器を必要とせずに高精度で手のポーズをインタラクティブに捉えるためのdeep learningを用いたストレッチセンシングソフトグローブを提案します。高精度なハンドトラッキングは、外部モーションキャプチャシステムを必要としますが、高価であったり嵩張ったりします。

そこで本提案では、伸縮性により着心地がよく着脱も容易、そして軽量、それでいて手間のかかるキャリブレーションや複雑な設定を必要とせずにリアルタイムかつ正確に追跡するグローブベースのハンドトラッキングシステムを検証します。低コストも魅力です。また、カメラベースでないためオクルージョンによる精度低下も避けられ、照明条件にも左右されないメリットもあります。

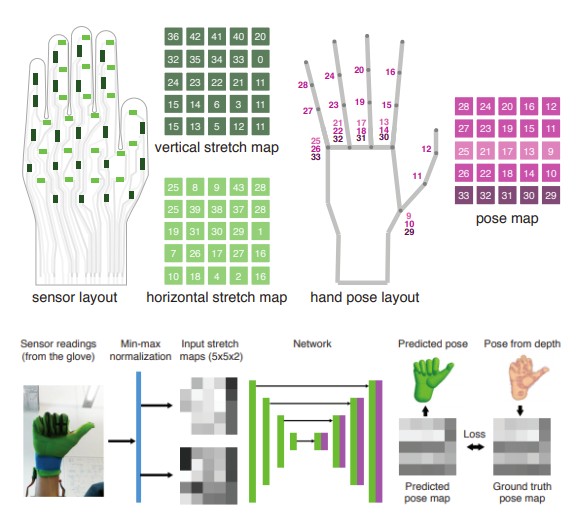

本グローブは、2つの導電性シリコーンからなる厚さ1.2mm、総重量50gの手袋です。片手あたり44個のセンサーが整備されています。44個から得られるデータをもとに作成したデータセットを用いて、ニューラルネットワークを訓練します。

訓練したモデルを使用することで、レイテンシ125から200ミリ秒の範囲でポーズを出力します。本手法はVR/ARなどで活用できるほか、触覚デバイスの下に着用する応用も可能ではと述べています。