山東大学やサイモン・フレイザー大学などによる研究チームは、3D屋内シーンの階層構造を学習するための生成的ニューラルネットワーク「GRAINS」を発表しました。

論文:GRAINS: Generative Recursive Autoencoders for Indoor Scenes

著者:Manyi Li, Akshay Gadi Patil, Kai Xu, Siddhartha Chaudhuri, Owais Khan, Ariel Shamir, Changhe Tu, Baoquan Chen, Daniel Cohen-Or, Hao Zhang

所属:Shandong University, Simon Fraser University, National University of Defence Technology, Adobe Research, IIT Bombay, The Interdisciplinary Center, Peking University, Tel-Aviv University

GitHub – ManyiLi12345/GRAINS: GRAINS: Generative Recursive Autoencoders for INdoor Scenes

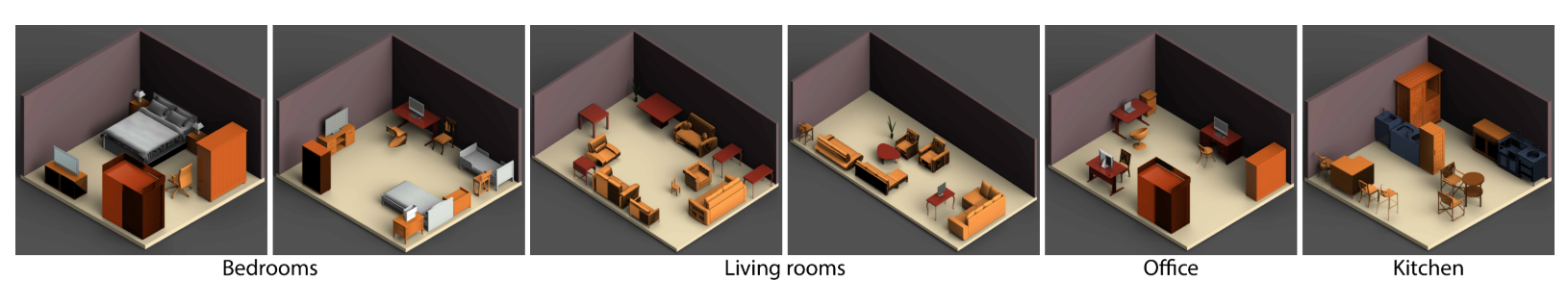

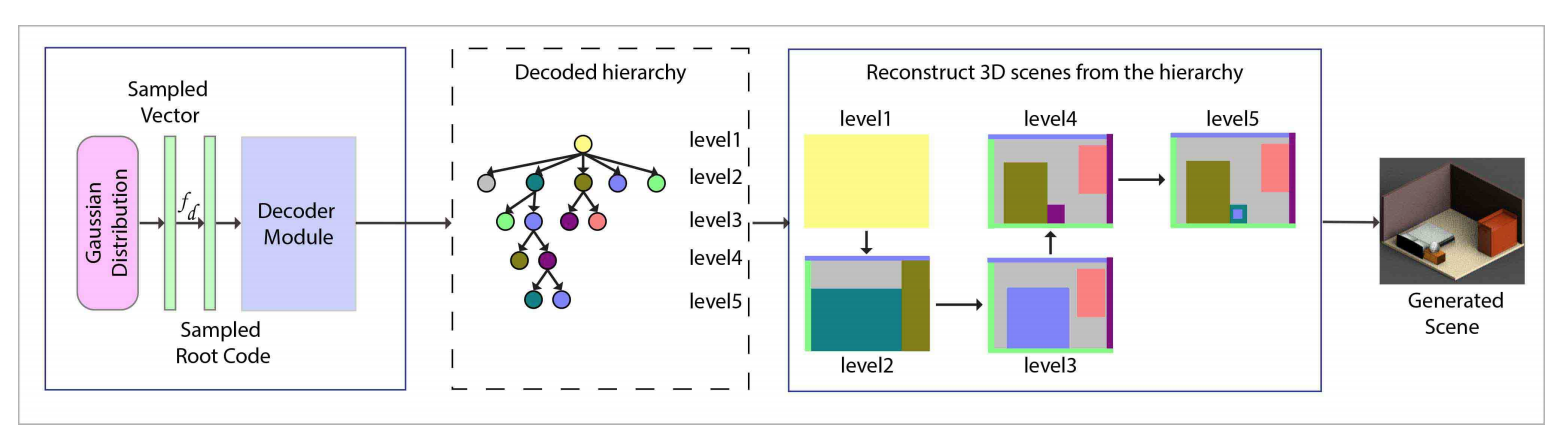

本論文は、多様な形式のもっともらしい3D屋内シーンを効率的に大量生成できるニューラルネットワークを提案します。本提案は、再帰型ニューラルネットワーク(RvNN)と変分オートエンコーダ(VAE)を統合したもので、畳み込みではなく階層ベースに訓練されます。

ネットワーク設計は、長方形の部屋をベースにオブジェクトの共起関係に基づき、相対的なオブジェクトの位置決め、階層内の他のオブジェクトに対するそれらの相対位置に関する情報を符号化します。符号化するために、シーンのラベル付きOBB(Oriented Bounding Box)を使用します。

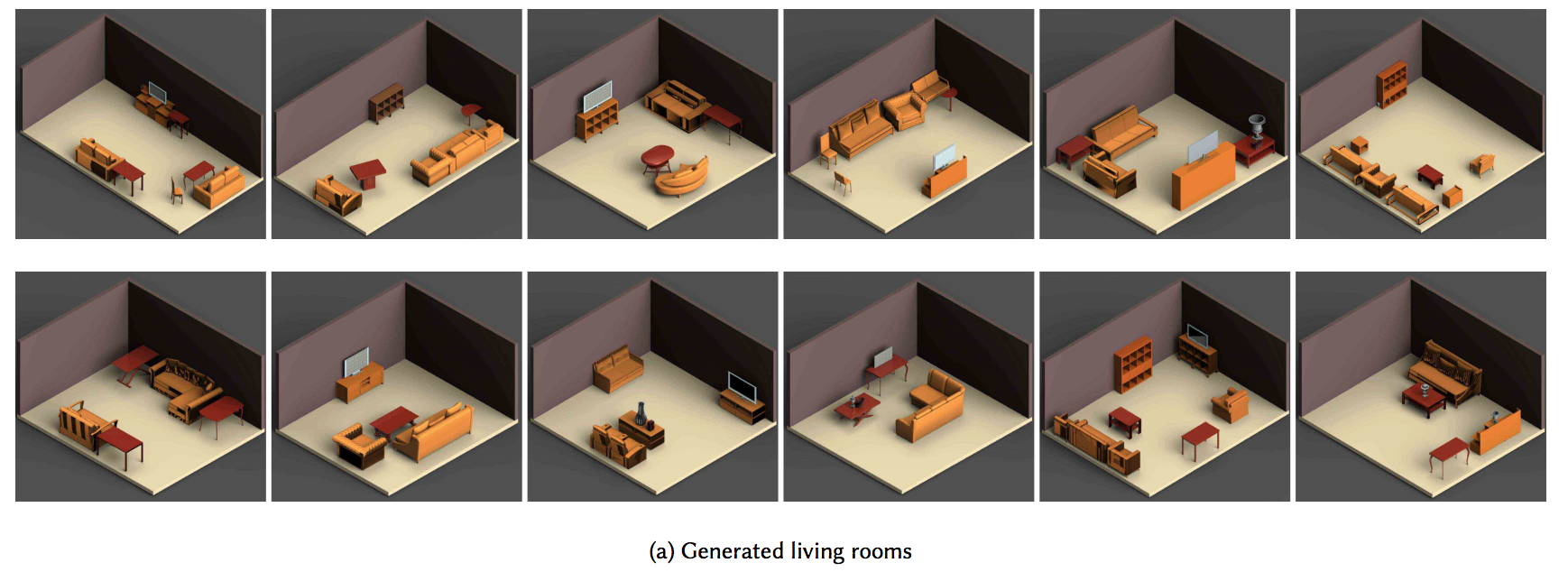

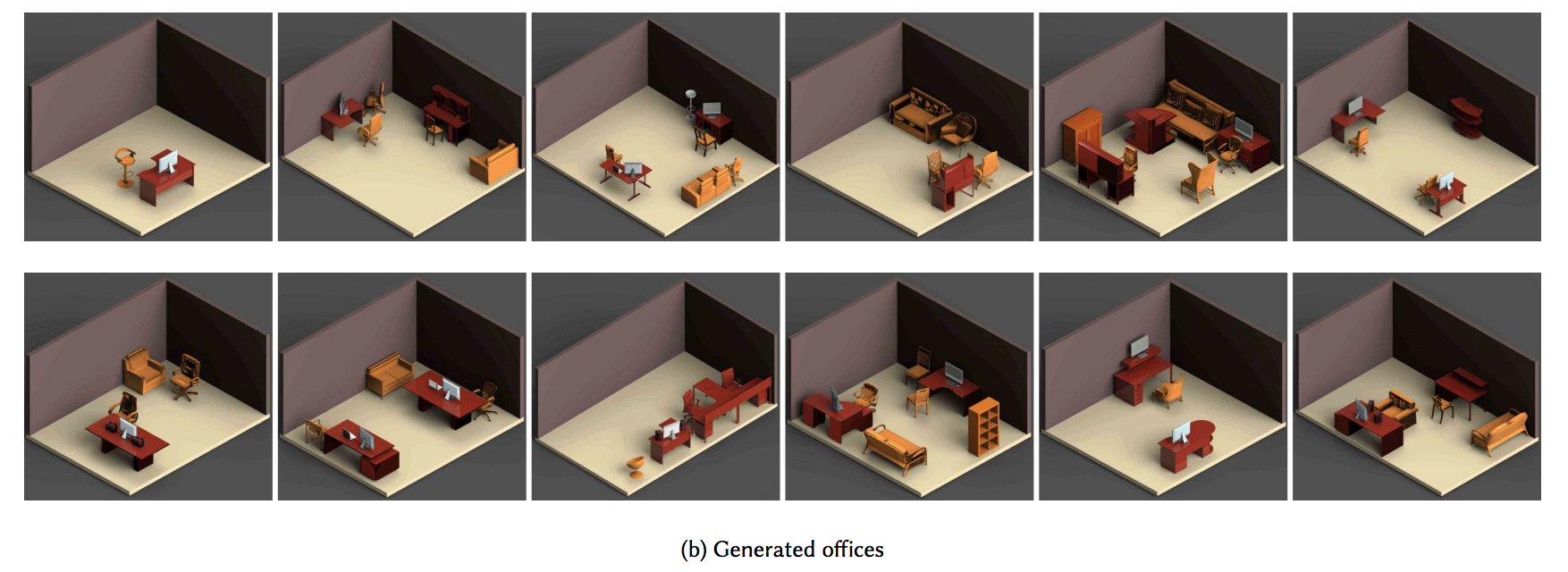

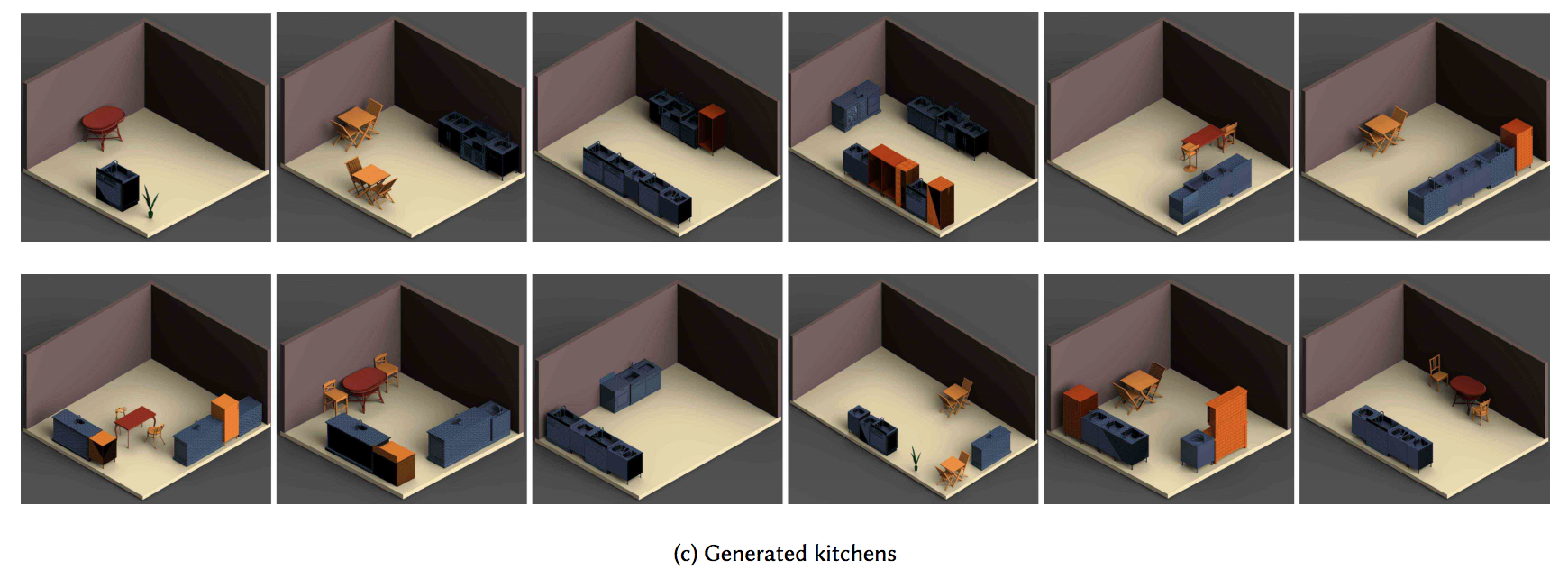

訓練されたモデルは、ランダムベクトルから1秒以内に新しくもっともらしい3D屋内シーンの生成を可能にします。欠点としては、生成したシーン内のオブジェクトを直接制御できない点は言えます。以下が出力結果です。上からリビングルーム、オフィス、キッチンです。