スタンフォード大学、ブラウン大学、Google、DeepMind、ミュンヘン工科大学の研究者らは、シーンの3Dスキャンを入力に、CNN(convolutional neural network)を用いて欠落部分を推定し、ラベルが付いたボクセルベースの3Dモデルを生成する手法「ScanComplete」を発表しました。

論文:ScanComplete: Large-Scale Scene Completion and Semantic Segmentation for 3D Scans

著者:Angela Dai, Daniel Ritchie, Martin Bokeloh, Scott Reed, Jürgen Sturm, Matthias Nießner

GitHub – angeladai/ScanComplete

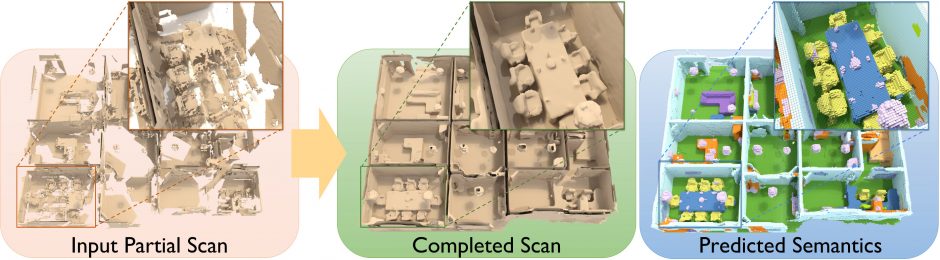

(左:室内の不完全な3Dジオメトリ、中央:Fully-CNNを用いて欠落部分を補完し再構成、右:ボクセルベースの再構成)

昨今、安価なRGB-Dセンサにより、屋内空間の3Dスキャンによる再構成が容易になりましたが、精度はまだ不十分です。本稿は、そんな3D再構成を機械学習を用いた今までのアプローチよりも優れたアプローチを提案します。

本提案手法は、室内シーンにおける深度データTSDF(truncated signed distance field)を入力に、Fully-CNNを用いたScanCompleteネットワークアーキテクチャから欠落しているジオメトリを推定し、最大1480×1230×64ボクセル(約70×60×3m)としての再構築を出力します。

訓練には、部分的なTSDFと完全なTDFのトレーニングペアで行います。