大連理工大学、ByteDance AI Lab、Adobe Research、Adobe Systemsの研究者らは、スマートフォンカメラなどの一般的なカメラで撮影された1枚の画像にDoF(Depth of field:被写界深度)効果を生成する機械学習を用いた手法「DeepLens」を発表しました。

論文:DeepLens: Shallow Depth Of Field From A Single Image

著者:Lijun Wang, Xiaohui Shen, Jianming Zhang, Oliver Wang, Zhe Lin, Chih-Yao Hsieh, Sarah Kong, Huchuan Lu

本論文は、通常のモバイルデバイスのカメラで撮影された全焦点写真にDoF効果をもたらすニューラルネットワークを用いた手法を提案します。焦点位置やぼかし加減も調整できます。

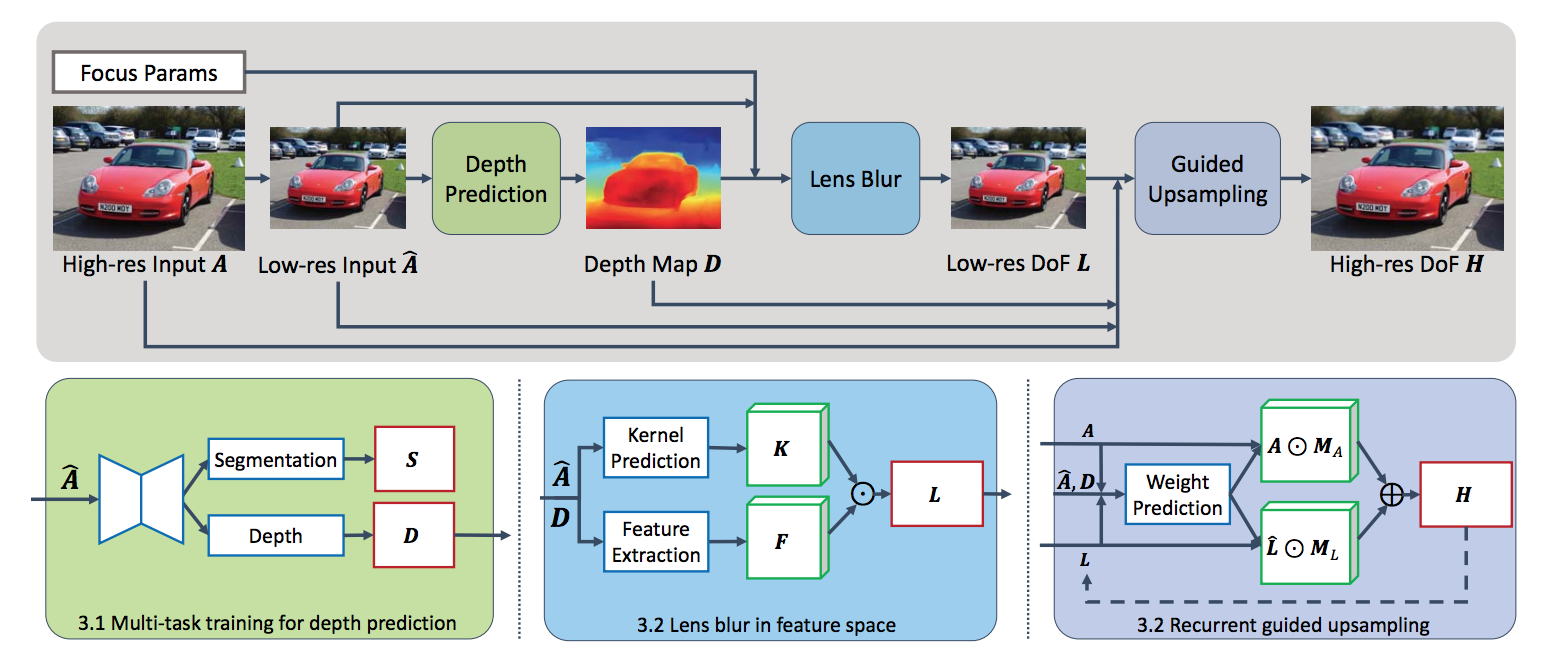

本提案手法は、単一の画像深度推定のための「Depth Predictionモジュール」、空間的に変化するボケフィルタを予測する「Lens Blurモジュール」、および高解像度のDoF画像を生成するための「Guided Upsamplingモジュール」から構成されます。

デュアルレンズカメラで収集したRGB-Dデータセットで訓練したCNN(Convolutional Neural Network)で深度マップを推定し、オブジェクト境界周りのアーティファクトを軽減するために、アーティファクトのない合成データセットで訓練されたニューラルネットワークを使用し、より少ないアーティファクトの結果を生成します。そして、アップサンプリングネットワークを用いて、解像度を上げて高解像度で出力します。

これにより、モバイルカメラからの画像からDoFを調整することができ、iPhoneのポートレートモードと違って、フォーカルポイントとアパーチャーサイズを柔軟に選択することが可能です。

限界として、本システムは最後にアップサンプリングしていますが、現段階ではGPU性能から低解像度でのアプローチしかできない制限があり、高解像度で直接パイプラインを実行できれば、より精度を向上させることができると述べています。