スタンフォード大学とプリンストン大学の研究者らは、機械学習を用いて自然言語のテキストから3Dモデルを生成および検索する手法を発表しました。

論文:Text2Shape: Generating Shapes from Natural Language by Learning Joint Embeddings

著者:Kevin Chen, Christopher B. Choy, Manolis Savva, Angel X. Chang, Thomas Funkhouser, Silvio Savarese

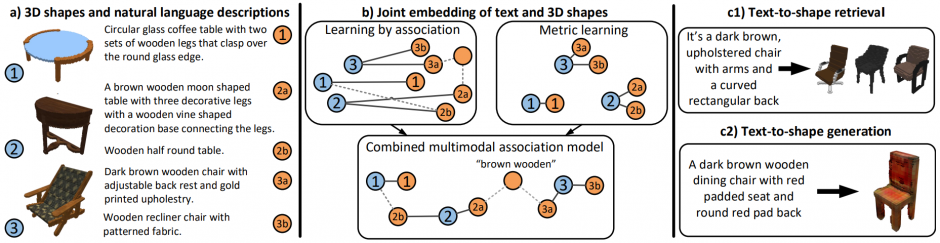

本稿では、自然言語から色付きの3D形状を検索及び生成するエンドツーエンドの機械学習フレームワークを提案します。

最初に、テキストと3D形状の組み合わせJoint Embedding(埋め込み)を学びます。データセットは、3DモデルのShapeNetから取得し作成します。

そして、学習されたJoint Embeddingを用いて、入力テキストクエリと一致する形状を何千もの椅子とテーブルを持つデータセットから検索します。

また、敵対生成学習のCWGAN(Conditional Wasserstein Generative Adversarial Network)と組み合わせることで、自由形式のテキストから新たな形状を生成します。

下図では、左に入力テキスト、右から2番目が本提案のCWGANを用いた生成の結果を確認できます。一番右がGround Truth(正解データ)です。

関連

香港城市大学ら、手描きスケッチから法線マッピングを推論する敵対生成学習(Wasserstein GAN)を用いた手法を発表 | Seamless