エバーハルト・カール大学テュービンゲンなどによる研究チームは、小さな画像パッチから全体画像を分類するDeep Neural Networks (DNNs) アーキテクチャ「Deep bag-of-features models (BagNets)」を発表しました。

論文:Approximating CNNs with Bag-of-local-Features models works surprisingly well on ImageNet

著者:Wieland Brendel, Matthias Bethge

所属:Eberhard Karls University of Tübingen, Germany; Werner Reichardt Centre for Integrative Neuroscience, Tübingen, Germany; Bernstein Center for Computational Neuroscience, Tübingen, Germany

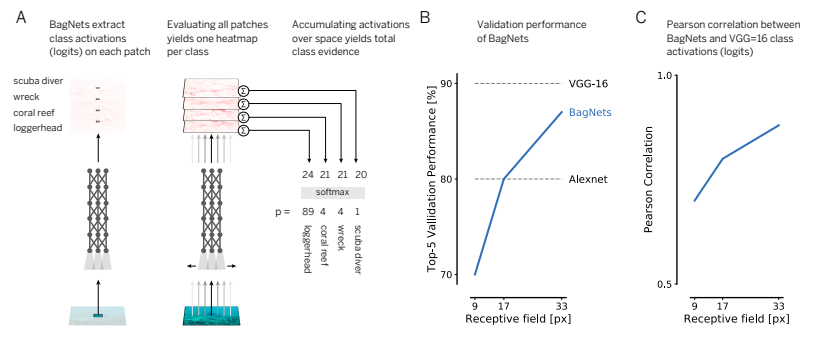

本論文は、局所特徴量の情報に基づいて画像を分類するDNNを用いたアプローチを提案します。本提案は、画像を局所特徴量の集合とみなし、特徴量の出現頻度で画像を分類する手法「Bag-of-Feature(BoF)」モデルとDNNを組み合わせることで画像分類を行います。BoFは、CNN(Convolution Neural Network)が登場するまでは、画像認識において主流のアプローチでした。この以前のアプローチを活用することで、より良いパフォーマンスを出せるか検討します。

本手法は、入力画像を33×33(17×17より優れている)のパッチに切り取り、各パッチをネットワーク(1×1畳み込み)に通してクラスベクトルを取得し、得られたクラスベクトルを空間的に(全てのパッチにわたって)合計することで分類を決定します。

結果、画像データセットImageNetにおいて、本手法(86% 精度)の方が、deep AlexNet model (84.7% top-5 精度)と比較して優れていることを報告しました。

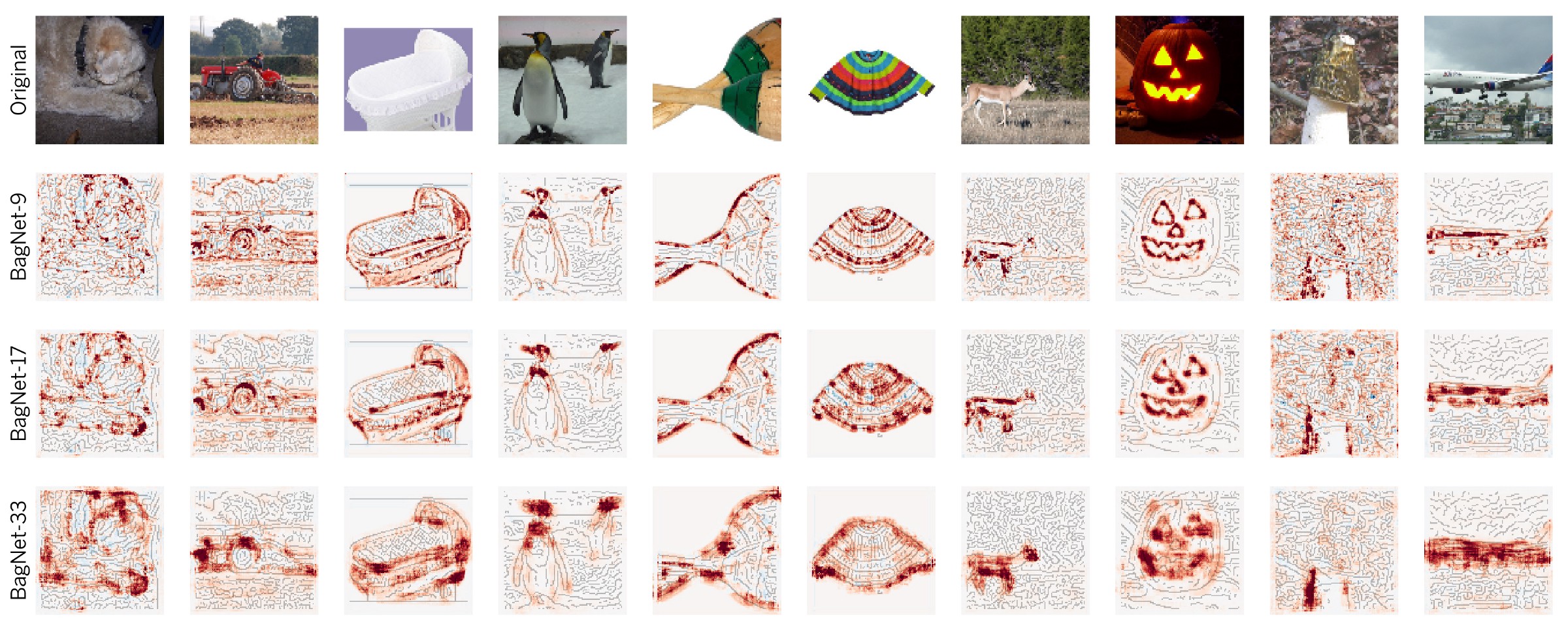

また、本手法の特長としては、意思決定プロセスが可視化されているところにあります。例えば、下図のように、どの画像特徴が最も正しくクラスを予測したかなどを確認することができます。

同様に、画像のどの部分が決定に寄与したかを示すヒートマップも取得します。