独マックス・プランク情報科学研究所(Max Planck Institute for Informatics)とスイス連邦工科大学ローザンヌ校(EPFL)の研究者らは、1台の単眼カメラで撮影した映像を入力に、人間のポーズから着用する衣服までを3D再構築するマーカレスパフォーマンスキャプチャ技術「MonoPerfCap」を発表しました。

論文:MonoPerfCap: Human Performance Capture from Monocular Video

著者:Weipeng Xu, Avishek Chatterjee, Michael Zollhoefer, Helge Rhodin, Dushyant Mehta, Hans-Peter Seidel, Christian Theobalt

本稿は、単眼カメラから撮影した映像を基に、人間の関節動作からスキンや衣服の非剛体変更までを再構成するCNN(convolutional neural network )を用いたマーカレスパフォーマンスキャプチャシステムを提案します。

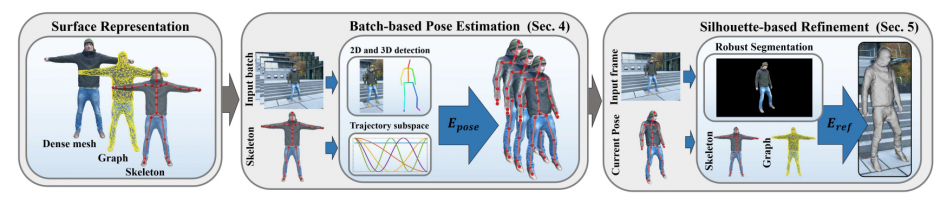

本提案手法は、Batchベースの3Dポーズ推定と、シルエットベースのポーズ及びサーフェスのリファインメントによる2ステップに基づいています。メッシュは、予め人物を静的姿勢で撮影し取得したものを使用します。

本提案手法を用いることで、人の姿勢推定だけでなく、着用する衣服などの動きも再構築することができ、自由な視点でレンダリングすることを可能にします。ただし、高速な動きや強力なオクルージョンは不安定になります。(隠れたパーツが再度見えると回復はします。)

今後の研究としては、本提案手法におけるリアルタイムソリューションを課題としています。