ドイツ:マックス・プランク情報科学研究所、ザールランド大学、スタンフォード大学、バース大学の研究者らは、単一のカメラで撮影した画像から物理オブジェクトのマテリアルをリアルタイムに推定し、そのマテリアルを仮想オブジェクトに複製する技術「LIME」を発表しました。

論文:LIME: Live Intrinsic Material Estimation

著者:Abhimitra Meka、 Maxim Maximov、Michael Zollhöfer、Avishek Chatterjee、 Hans-Peter Seidel、 Christian Richardt、Christian Theobalt

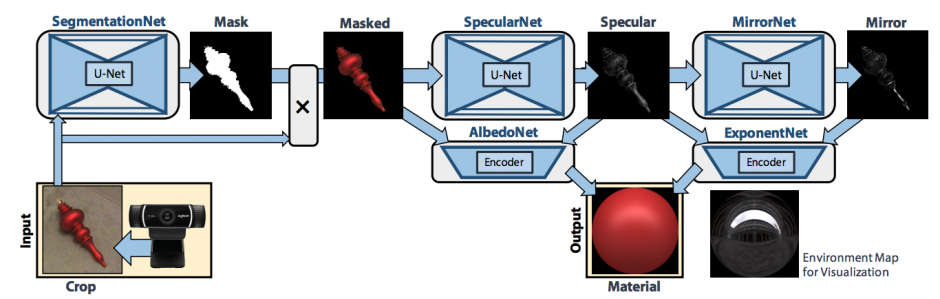

本稿は、キャプチャした物理オブジェクトのマテリアルおよびセグメンテーションマスクを推定し、新たな仮想オブジェクトにその質感を再現することができるエンドツーエンド手法を提案します。例えば、下の画像では、赤い車のマテリアルを仮想オブジェクトであるラビットにクローンしています。

本提案手法は、1台のRGBカメラでオブジェクトを1つずつ撮影し、ネットワークを通したリアルタイム推定を行います。ランバート反射、鏡面反射光などオブジェクトの光沢やセグメンテーションを計算、5つのサブネットワークを用います。

ただし、多くの日常的なオブジェクトではうまく機能しますが、より複雑なBRDFではうまく扱えないとのことです。

関連

南カリフォルニア大学、単一の顔画像からリアルタイム用アバターの顔や髪形を再構成する提案の論文概要を発表。髪形には深層畳み込みニューラルネットワークを使用 | Seamless