中国科学院と香港城市大学による研究チームが開発した「DeepFaceDrawing」は、手書きスケッチからリアルな顔画像を生成する深層学習フレームワークだ。

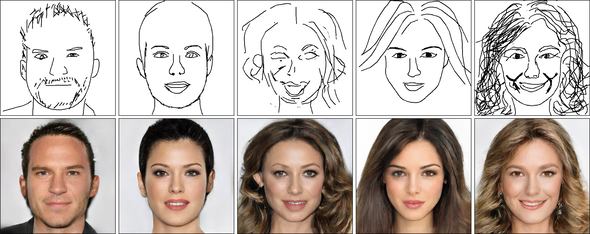

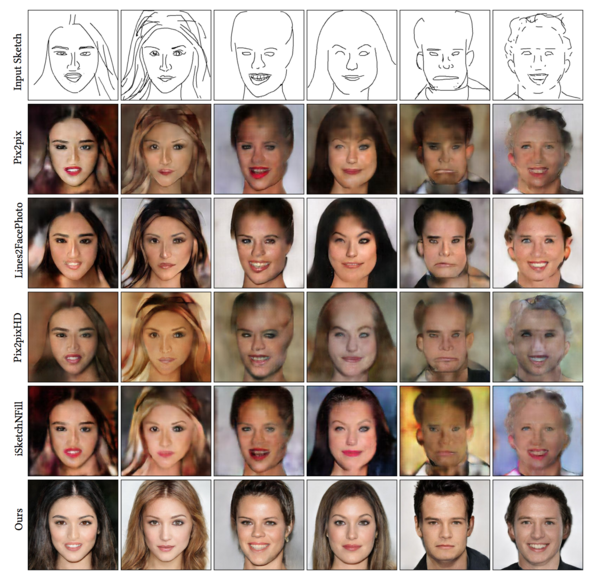

このような深層学習を用いたスケッチ画像からリアル画像への変換では、Image-to-Image Translation with Conditional Adversarial Nets [Isola et al. 2017] などで実証されている。しかしデータ駆動型の性質上、実画像とそれに対応するエッジマップのペアからネットワークを学習することが多いため、リアルな顔画像を合成するためには、実画像のエッジマップに近い品質のテストスケッチが必要となる。それを用意するのは困難である。

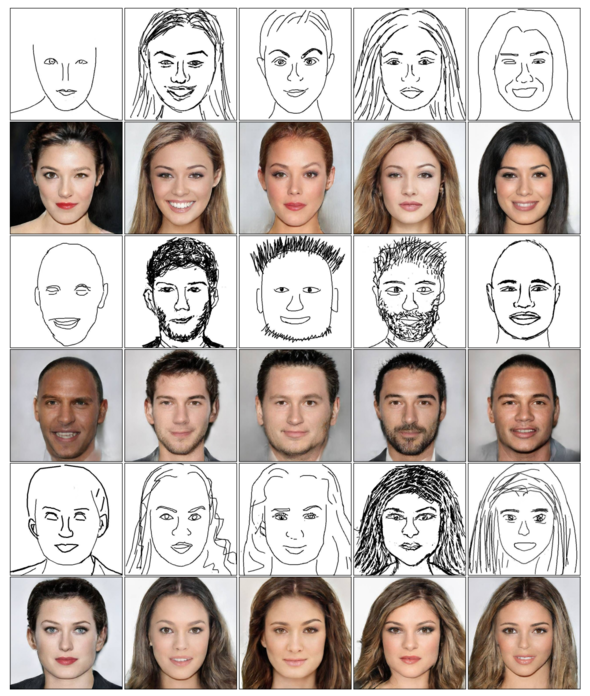

そこで本手法では、実際の顔スケッチ画像から、もっともらしい顔を学習し、入力スケッチに最も近い点を見つけて近似する。大まかな入力スケッチや不完全な入力スケッチであっても、スケッチに表される特徴を尊重しながら、合成画像の信憑性を高める。

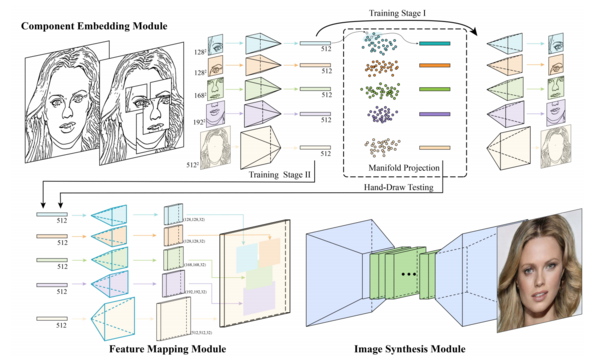

本システムは、CE(Component Embedding)、FM(Feature Mapping)、IS(Image Synthesis)の3つのモジュールから構成される。CEモジュールは、オートエンコーダーアーキテクチャを採用し、顔のスケッチデータから「左目」、「右目」、「鼻」、「口」、「その他」の5つの特徴記述子を、局所的かつ全体にまたがるよう個別に学習する。

FMとISモジュールは、条件付き画像生成のための別の深層学習サブネットワークを形成し、構成要素の特徴ベクトルを現実的な画像にマッピングする。ローカルからグローバルへのアプローチを採用する。デコード部分は、特徴ベクトルを32チャンネルの特徴マップにマッピングすることで、より高品質な合成結果を出力する。

これにより生成される画像は、入力スケッチを忠実に再現した高品質でリアルな顔画像(解像度512×512)として出力される。

昨今の類似研究と比較しても良質な出力結果を示している。

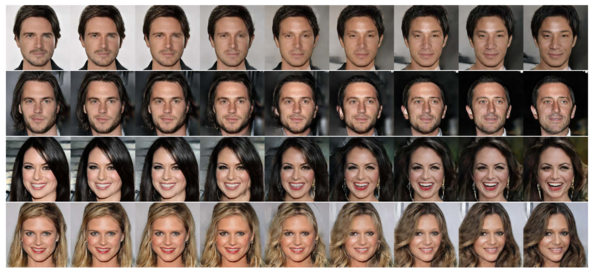

応用した2つのアプリケーションも作成した。(1)数枚の顔写真から切り出した構成要素(目、鼻、口、その他)を組み替えて合成した新たな顔を作成するアプリケーション、(2)与えられた2つの顔の特徴ベクトルを補間することによる顔のモーフィングアプリケーション。