ケンブリッジ大学、カーネギーメロン大学、マックス・プランク情報科学研究所、Microsoftの研究者らは、動画内の人の視線をリダイレクトする新しいアプローチ「GazeDirector」を発表しました。

論文:GazeDirector: Fully Articulated Eye Gaze Redirection in Video

著者:Erroll Wood、 Tadas Baltrusaitis、 Louis-Philippe Morency、 Peter Robinson、 Andreas Bulling

本稿は、個人固有のトレーニングデータを必要とせずとも、動画内の人々が見ている視線方向を正確に指定することができるアプローチを提案します。

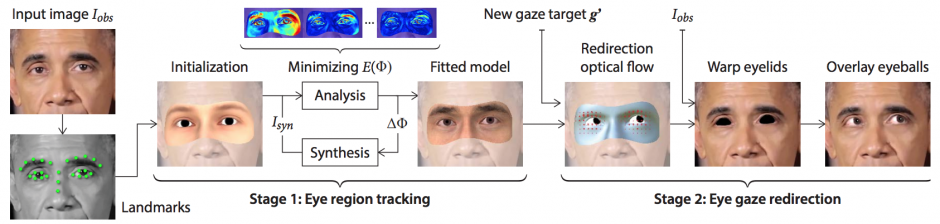

提案手法は、目領域の追跡と視線のリダイレクションという2つの段階で構成されます。

両目に目領域の3D変形可能モデルを適合させます。次に、元の視線と所望の視線方向との間の眼瞼運動に対応するモデルを計算し、まぶたを歪ませ、リダイレクトされた眼球をフォトリアリスティックな方法でレンダリングし合成させます。眼球と皮膚の境界をぼかすことで、トランジションを柔らかくしています。

これらにより、後から人の眼球を任意の角度に移動することができ、例えば、集合写真で全員をカメラ目線にしたり、CGキャラクタとの対話で視線を合わせる調整をしたり、などが可能になります。

(a:赤枠の3人がカメラ目線でない。b:その3人をカメラ目線に再構成。cとd:CGキャラクタの位置に合わせて視線を調整。)

ただし、まばたきや、眩しい時に目を細める仕草、メガネなど目の前に物体がある場合に対しては扱っておらず、また、まつ毛も考慮していないとしています。

関連

NVIDIAら、Conditional GANを用いて任意の画像から2048×1024高解像度のフォトリアリスティックな画像合成モデルを生成できる手法を論文にて発表 | Seamless