ドイツの研究機関「Max Planck Institute for Informatics」と大阪大学の研究者らは、単一のカメラだけで任意の対象物がどれだけ注視されてるかをリアルタイム検出する機械学習を用いたアイコンタクト検出手法を提案した論文を発表しました。

Everyday Eye Contact Detection Using Unsupervised Gaze Target Discovery(PDF)

視線追跡をする場合、キャリブレーションが必要であったり、変化する照明条件下であったり、複数人だったりすると、正確なデータが取得できないのが現状です。

本稿では、1台のカメラとDeep learningを用いて視線方向を推定するための新たなアルゴリズムを採用することで、屋外でも複数人でもデータを取得することができるアイコンタクト検出方法を提案します。

1台のRGBカメラを対象物の近隣にセットすることで実行します。

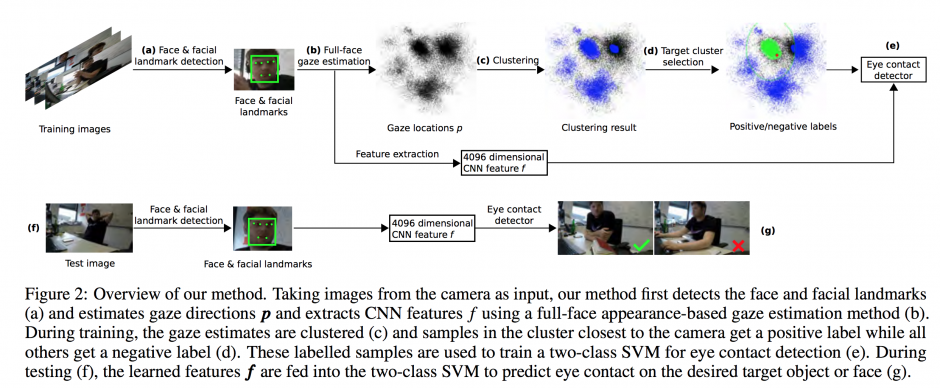

提案手法では、まずカメラから顔と顔のランドマークを検出、視線の方向を推定、顔の特徴を抽出します。そして、注視推定値はクラスタリングされ、近いサンプルにはポジティブラベル、離れたサンプルにはネガティブラベルが割り当てられ、ラベリングされたサンプルは学習に使用されます。

(提案手法のパイプライン。上段が学習ライン、下段がテストライン。)

テストでは、ワークスペース近くにカメラをセットした状況と、メガネにマウントした状況下で行われました。結果、人の数、照明条件、カメラ位置、対象物の寸法の変化にかかわらず、装置が動作することを実証しました。

(上段がテスト環境:赤がカメラ、緑が対象物、青が周囲オブジェクト。下段がクラスタリング:赤点がカメラ、緑点がターゲットクラスタ、青点がネガティブクラスタ)

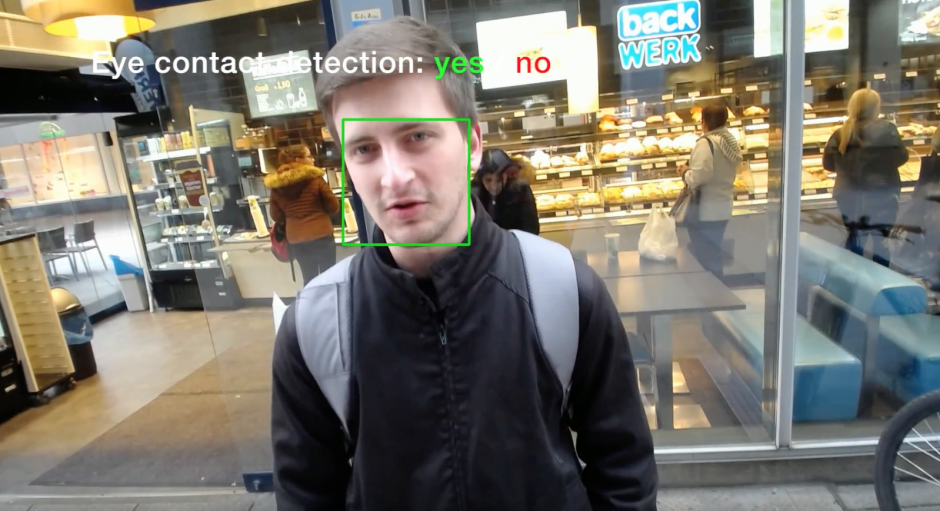

このことで、街中の広告が道行く歩行者にどれだけ見られているかのデータを取得することができるほか、カメラをメガネ等にマウントすることで、自分自身がどれだけ見られてるかをリアルタイムに計測することが可能になります。

関連

NVIDIA Researchら、視線先だけを高画質に描画する「中心窩レンダリング」とフォーカス調整ができる「4Dライトフィールド・ディスプレイ」を統合させた提案を論文にて発表 | Seamless